Wo ist die Schärfentiefe hin?

Ein Thema mit Technikalarm! (Aber am Ende geht es dann doch um Gestaltungsmöglichkeiten.)

Vor einiger Zeit fiel mir auf, dass die Schärentiefeanzeigen einiger Kameras bzw. Objektive ungewöhnliche Werte anzeigten, die sich nicht mit meinen Erfahrungen und den Werten anderer Skalen und Tabellen deckten.

Was war passiert? Meine Neugier war geweckt, ich wollte dem auf den Grund gehen.

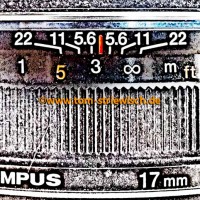

Aber der Reihe nach. Am liebsten fotografiere ich ja im Bereich leichter Weitwinkel – also nutze ich 35mm an Vollformat, 23mm an APS-C oder (weil klein und leicht und gut) 17mm an meiner Olympus E-M1(*).

In diesem Brennweitenbereich mit etwa 50°-60° Bildwinkel fotografiere ich in Bezug auf die Schärfentiefe meist eher nach Gefühl. Mein 17mm Olympus hätte zwar im Prinzip eine Schärfentiefenskala, aber ich benutze überwiegend den „manuellen Autofokus“ (Backbuttonfokus), und im Autofokusmodus ist diese Schärfentiefeskala nicht sichtbar. Auch deshalb beachte ich sie normalerweise gar nicht.

Aber vor einigen Tagen habe ich mit dem Objektiv etwas herumgespielt und da fiel mir an dieser Anzeige etwas ungewöhnliches auf.

Die an der Skala angezeigten Bereiche der Schärfentiefe sind viel kleiner als ich das in Erinnerung habe (und passen auch nicht zu meinen Praxiserfahrungen).

Beispiel

Bei Einstellung auf 3m Abstand und Blende 22 (würde ich wegen der Beugungsunschärfe ja eigentlich nicht nehmen, ist aber in diesem Beispiel am besten abzulesen) reicht die Schärfentiefe dann angeblich nur von 1.5m (5 feet) bis unendlich. Das kommt mir sehr gering vor.

Um das zu überprüfen, habe ich mein altes 35mm 2.0 Canon herausgeholt. Das ist ein Objektiv mit dem gleichen Bildwinkel (siehe Cropfaktor) an Vollformat. Bei einem größeren Sensor sollte bei gleicher Entfernung, gleicher Blende und gleichem Bildwinkel der Schärfentiefebereich eigentlich kleiner sein. Tatsächlich war der am Canon 35er angezeigte Bereich aber sogar größer, er ging von 1,2m bis „hinter unendlich“.

Warum? Was war hier los?

Verdacht

Etwas ähnliches habe ich vor einigen Jahren schon einmal bemerkt. Meine „Beinahe-Lieblingskamera„, die Fuji X100, konnte die eingestellte Entfernung und die sich ergebende Schärfentiefe auf dem Display (und im elektronischen Sucher) anzeigen. (Warum die meisten Canons, Nikons, etc. das nicht können, ist mir schleierhaft. Ist doch nur ein bisschen Mathe, dass sollten doch auch die Ingenieure und Entwickler bei diesen Firmen beherrschen. ;-) )

Die Schärfentiefeanzeige der Fuji deckte sich frisch nach dem Kauf mit meinen Erwartungen und Erfahrungen. Doch nach einem Firmware-Update, dass einige interessante neue Funktionen mit sich brachte, war die angezeigte Schärfentiefe viel kleiner.

Wohlmöglich hängen beide Beobachtungen ja miteinander zusammen.

Doch warum sollte die Schärfentiefeanzeige so stark abweichen bzw. sich auf einmal ändern?Was ist die Ursache?

Mein Verdacht richtet sich auf die 100%-Option bei Absicht der Bilder am Rechner.

Schärfentiefe

Um die Ursache herauszufinden, müssen wir uns zuerst mit dem grundlegenden Konzept der „Schärfentiefe“ beschäftigen.

Schon der Begriff lenkt die Aufmerksamkeit ja etwas in die falsche Richtung, eigentlich geht es dabei ja gar nicht so sehr um Schärfe als vielmehr um (möglichst kleine und somit nicht wahrnehmbare) Unschärfe. Das Konzept der Schärfentiefe basiert auf der Überlegung, dass eine Unschärfe so gering sein kann, dass man sie nicht bemerkt.

Schärfentiefeskala an einem Schiebezoom Tokina 70-210 1:4–5.6 für Minolta MD Bajonett, nach dem Zoomen kann automatisch der zur neuen Brennweite passende Wert abgelesen werden.

Natürlich spielt in diesem Zusammenhang der Abstand eine Rolle, aus dem man das Bild betrachtet. Dieser Abstand kann ja prinzipiell beliebig groß oder klein sein, so dass man die Schärfentiefe eigentlich nicht allgemeingültig berechnen kann.

Aber man kann mit etwas Überlegung durchaus eine Art „Idealabstand“ annehmen. Denn wenn man sich für ein Bild interessiert, wird man möglichst nah herangehen. Aber man wird andererseits soweit weg bleiben, dass man das Bild noch als Ganzes sieht. Denn nur, wenn man das Bild noch als Einheit überblickt, kann man die verschiedenen Gestaltungselemente (z.B. Linien und Formen), die innerhalb des Bildes zusammenwirken, noch erkennen. Diesen Abstand wird man also zuerst mal nicht unterschreiten.

Damit ergibt sich ein Art idealer Betrachtungsabstand. Der entspricht in etwa der Diagonale des Bildes. Wäre man weiter entfernt, würden Bilddetails verloren gehen, wäre man näher dran, könnte man bestimmte Gestaltungsaspekte nicht mehr wahrnehmen.

Einen ersten wichtigen Punkt für die Berechnung der Schärfentiefe können wir damit also festlegen.

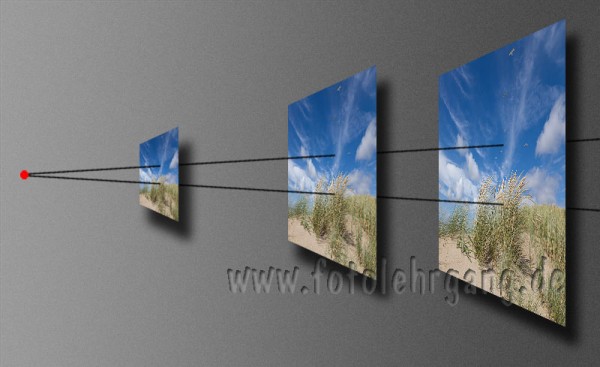

Bei zum Abstand proportionaler Bildgröße sind Details immer im Verhältnis gleich groß (Strahlensatz)

Augenauflösung

Um zwei Details in einem Bild voneinander unterscheiden zu können, müssen sie einen bestimmten Mindestabstand haben. Dieser ist natürlich auch von der Sehkraft des Betrachters abhängig, aber selbst ein wirklich gut sehender Mensch benötigt einen gewissen Mindestabstand zwischen zwei Punkten, um sie als einzelne Punkte wahrnehmen zu können. Ein Unschärfe, die kleiner ist, kann auch jemand mit Adleraugen nicht als Unschärfe erkennen.

Unschärfe bedeutet, dass ein winzig kleiner Punkt nicht mehr als Punkt, sondern als Fläche (Kreis) wiedergeben wird. Und die Fläche wächst mit der Unschärfe. Doch solange die Unschärfe nicht zu groß wird, kann man sie nicht erkennen, das Bild wirkt noch scharf.

Wenn man jetzt die Sehschärfe eines Menschen mit guten Augen zugrunde legt und den Abstand in Relation zur Bildgröße kennt, kann man berechnen, wie groß ein Unschärfekreis (Zerstreuungskreis) auf dem Sensor werden darf, damit er später im vergrößerten Bild dem Betrachter doch noch als scharfer Punkt erscheint.

Das Bild kleinerer Sensoren wird stärker vergrößert, der Zerstreuungskreis muss hier also kleiner sein. Bilder von größeren Sensoren dürfen dagegen auch größere Zerstreuungskreise aufweisen.

Durch den (in Bezug auf die Bildgröße) relativen Betrachtungsabstand kann man den Zerstreuungskreis festlegen. Und dieser bildet die Basis der Berechnung der Schärfentiefe und mit etwas Mathematik kann man nun ihren Nah- und den Fernpunkt errechnen. Alles was vor dem Nah- oder hinter dem Fernpunkt liegt, wird dem Betrachter immer unschärfer erscheinen, je weiter es entfernt ist. Was dagegen zwischen Nah- und Fernpunkt liegt, ist so schwach unscharf, dass der Betrachter es als scharf ansieht.

Für diese Art der Schärfentiefeberechnung haben sich über viele Jahre bestimmte Zerstreuungskreisgrößen als (zumindest oft) sinnvoll herausgestellt.

AKTUELL

Spätere Termine sind natürlich auch schon verfügbar.

-1

Sensorauflösung

Man kann aber natürlich auch ganz anders vorgehen und sich bei der Berechnung auf das Auflösungsvermögen des Sensors beziehen. Der Sensor hat ja eine feste Größe und eine feste Anzahl an Bildpunkten. So kann man berechnen, wie klein ein Detail maximal werden darf, bevor es „zwischen die Sensoren“ fällt und nicht mehr erkannt werden kann.

Eine Unschärfe, die so klein oder kleiner ist, könnte man in so einem Fall nicht erkennen, da sie unterhalb der Auflösung des Sensors wäre. Es wäre dann also nicht mehr die Schärfe, sondern die Pixelgröße die begrenzende Einheit in Bezug aus die Schärfe.

Während die klassische Schärfentiefeberechnung in der Regel eine maximale Detailmenge im Bereich von bis zu 8 oder 10 Megapixeln ergibt (u.a. abhängig von der Aufnahmetechnik), haben moderne Kameras (die Objektive auch? ;-) ) deutlich höhere Auflösungen.

Damit sind dann auch Ausschnittvergrößerungen möglich. Oder Bilder, die eine deutlich kürzere Betrachtungsentfernung vertragen müssen.

Wenn man sich bei der Berechnung der Schärfentiefe nicht nur in solchen Ausnahmen, sondern generell auf die Auflösung der Sensoren bezieht, muss man deutlich kleinere Zerstreuungskreise annehmen, damit die Unschärfe auch auf Pixelebene noch unsichtbar bleibt.

100%

Verschärft wird diese Problematik noch durch einen der (aus meiner Sicht) „größten Nachteile der Digitalfotografie“, die 100% Ansicht. Zu analogen Zeiten wurden die Fotografien wegen der Kosten als Papierbilder meist nur so groß wie unbedingt nötig gemacht. Oft blieb man mit den Bildgrößen sogar unterhalb der für die Betrachtung idealen Größe. Das typische 10 x15-Bild ist eigentlich zu klein, für viele Menschen ist der sich ergebende Betrachtungsabstand zu kurz, um alle Details zu erkennen.

Digital dagegen kann man mit einen Mausklick und ohne Kosten in ein Bild hineinzoomen. Und weiter. Und noch weiter. Bis man die einzelnen Pixel auf dem Monitor sieht.

Man betrachtet dann aus kurzer Distanz einen Ausschnitt aus einem eigentlich sehr viel größeren Bild. Damit unterschreitet man natürlich stark den „sinnvollen Betrachtungsabstand“. Und so sieht man dann natürlich auch Unschärfen, die man bei einer normalen Betrachtung nicht sehen würde.

Der für die Berechnung der Schärfentiefe bei einer Betrachtung aus so kurzer Distanz nötige Zerstreuungskreis müsste jetzt viel kleiner sein.

Doch was bedeuten kleinere Zerstreuungskreise?

Kleine Zerstreuungskreise

Wenn die Anforderung an die Schärfe im Bild über das hinausgeht, was man mit bloßem Auge (aus dem „richtigen“ Betrachtungsabstand) sehen kann, muss dazu der Zerstreuungskreis kleiner werden.

Wenn man dann die Schärfentiefe nach dem neuen, nun kleineren Zerstreuungskreis berechnet, wird entweder der Bereich der Schärfentiefe kleiner, der Abstand zwischen Nah- und Fernpunkt schrumpft also.

Oder man muss für den gleichen Schärfentiefebereich eine kleinere Blendenöffnung verwenden.

Ein kleinere Blendenöffnung kann aber In Bezug auf die Bildqualität Schwierigkeiten machen. Man kommt so evtl. in den Bereich der Beugungsunschärfe.

Außerdem muss man bei gleicher Beleuchtung des Motivs entweder längere Belichtungszeiten wählen, dadurch wächst die Gefahr von Verwacklung oder evtl. unerwünschter Bewegungsunschärfe. Oder man muss die Empfindlichkeit (den ISO-Wert) anheben und erhält stärkeres Rauschen.

Mehr Schärfentiefe führt zu weniger Details?

Sei es die Beugungsunschärfe, das Verwackeln, die (evtl. unerwünschte) Bewegungsunschärfe oder das Rauschen, den Wunsch nach größerer Schärfentiefe bezahlst Du dann in jedem Fall mit Detailverlust — oder Komfortverlust, durch die Notwendigkeit ein Stativ einzusetzen. (Ich sage ja immer, dass Fotografie furchtbar(!) gerecht ist, den Vorteil x muss man mit dem Nachteil Y bezahlen.)

Aber es gibt nicht nur technische Auswirkungen mit Bezug auf die Bildqualität, auch bei der Gestaltung zeigen sich Konsequenzen.

Gestaltung

Kleinere Zerstreuungskreise führen auch zu einer schwächeren Unschärfe ausserhalb des Schärfentiefebereiches. Wer einen bestimmten Bereich scharf haben will und sich dabei wegen der 100%-Ansicht nach der „falschen“ Schärfentiefeberechnung richtet, muss in Kauf nehmen, dass im Hintergrund mehr evtl. ablenkende Details erkennbar sind. Auch der Abriss der Schärfe, der Übergang zwischen scharf und unscharf wird durch kleinere Zerstreuungskreise diffuser, die Trennung zwischen gewollt (scharf) und ungewollt (unscharf) wird schwächer.

Beides kann gestalterisch einen Nachteil bedeuten.

Vermutung

Ich vermute, dass die Kamerahersteller die Schärfentiefeanzeige in der Digitalfotografie nach und nach geändert haben, um sie der 100% Ansicht anzupassen. Die verwendeten Zahlen legen das nahe.

Vielleicht gab es ja immer mehr „Pixelpeeper“, die sich beschwert haben, dass in der 100% Ansicht Schärfentiefebereiche doch nicht ganz scharf waren.

Und bevor man nun darauf eingeht und den Zusammenhang erklärt, passt man einfach ganz pragmatisch die Schärfentiefeanzeige auf einen kleineren Zerstreuungskreis an.

Leider ist das aber ungünstig für denjenigen Fotografen, die ihre Bilder als Bilder betrachten wollen und denen die 100% Ansicht deshalb sch….egal ist. Diese werden durch die „falsche“ Berechnung der Schärfentiefe dazu verleitet, die Blende zu weit zu schließen und handeln sich dadurch unnötigerweise die oben genannten Probleme ein.

Es wird dann im Schwerpunkt um die Ausarbeitung von RAW-Dateien und um die sinnvolle Verwaltung der Bilder gehen, in erster Linie wird Lightroom (Classic) zum Einsatz kommen.

Natürlich ist auch Zeit für Fragen der Teilnehmer.

Zur Nacharbeit stelle ich umfangreiches Material in Form von Videos zur Verfügung und stehe regelmässig bei meinen Online-Fototreffen zur Verfügung.

Informationen und Anmeldung

Danke für die Aufmerksamkeit.

Anmerkung:

Es ist schon interessant zu beobachten, wie zwei Entwicklungen bei der Darstellung von Bildern zu ganz unterschiedlichen Erfahrungen führen.

Da gibt es mit der 100& Ansicht in der Digitalfotografie auf ganz einfache Art die früher für die allermeisten nicht vorhandene Kontrollmöglichkeit auch kleinster Bilddetails.

Und auf der anderen Seite werden die vermutlich meisten Bilder heutzutage am Smartphone betrachtet und erreichen so gerade eben die 10cm x 15cm Abmessungen früher üblicher „Vergrößerungen“. Und das ist zusätzlich noch verbunden mit einer Aufmerksamkeitsspanne für das einzelne Bild, die im Bereich von 10tel Sekunden oder kürzer liegen dürfte.

Da schießt dann die 100% Kontrolle am Monitor evtl. ein wenig über das Ziel hinaus.

Hat aber (leider) Auswirkungen.

Schlussfolgerung

Ich bin auf keinen Fall der Meinung, dass die Schärfentiefeanzeige nach Betrachtungsabstand das Optimum wäre, der eine oder andere Landschaftsfotograf, der sehr detailreiche und „übergroße“ Bilder machen möchte, würde sich mit Recht beschweren.

Es wäre aber wünschenswert, wenn die Kamerahersteller (und damit meine ich bewusst nicht nur Fuji und Olympus, sondern eben auch Canon, Nikon und andere.) endlich an allen Kameras sinnvolle Schärfentiefeanzeigen möglich machen würden.

Und diese Anzeigen sollten (über eine wählbare Größe des Zerstreuungskreisdurchmessers) an die Erwartungen des Kunden anpassbar sein. Wenn letzteres nicht möglich ist, würde ich allerdings zumindest eine Berechnung auf Basis des gestalteten Bildes und nicht auf Basis der 100% Ansicht vorziehen.

Deshalb habe ich natürlich auch meine eigenen Schärfentieferechenscheiben auf der Basis „Bildgestaltung“ entwickelt. Du kannst Sie Dir gerne unter diesem Link zu den Schärfentieferechenscheiben kostenlos laden und ausdrucken.

Was meinst Du?

Sollte die Schärfentiefe auf die maximal mögliche Auflösung berechnet werden?

Oder sollte das gestaltete Bild aus „normaler“ Entfernung als Kriterium dienen?

Oder sollte es anpassbar sein?

Zum gleichen Thema:

Schärfentieferechenscheibe benutzen (Video)

Schärfentiefe kontrollieren

Eine Frage zum Schärfentieferechner

Warum ich die Schärfentiefe anders berechne als Fuji, Olympus und Co.

Noch mehr Berichte und Tipps und Tricks zu Olympuskameras in meinem Blog

Mein Beitrag hat Dir geholfen?

Wenn du meinen Beitrag nützlich fandest, kannst du mir einen Gefallen tun.

Erzähl anderen von meinem Blog!

Du kannst ihn verlinken. Klick dazu einfach mit der rechten Maustaste auf diesen Link "https://www.tom-striewisch.de", kopiere ihn und füge ihn bei Facebook und Co. in deinen Beitrag ein.

Und natürlich freue ich mich auch, wenn Du mir (zumindest virtuell) einen Kaffee ausgibst.

Danke!